Memahami Teknologi USB Lebih dari Sekadar Pemasaran

Analisis berkelanjutan tentang memori kilas (flash memory), teknologi USB, dan keamanan data - dijelaskan secara jelas bagi mereka yang ingin memahami apa yang sebenarnya terjadi.

Area Pengetahuan Inti

Penyimpanan Kilas

Cara kerja NAND, mitos ketahanan, perilaku performa, dan tren harga.

Keamanan USB

Perlindungan salinan, risiko kebocoran data, proteksi tulis (write protection), dan realitas kepatuhan.

Integritas Data

Alat pengujian, drive berkapasitas palsu, masalah korupsi data, dan metode verifikasi.

Perangkat Keras USB

Apa yang ada di dalam flash drive, perilaku firmware, dan kompromi performa.

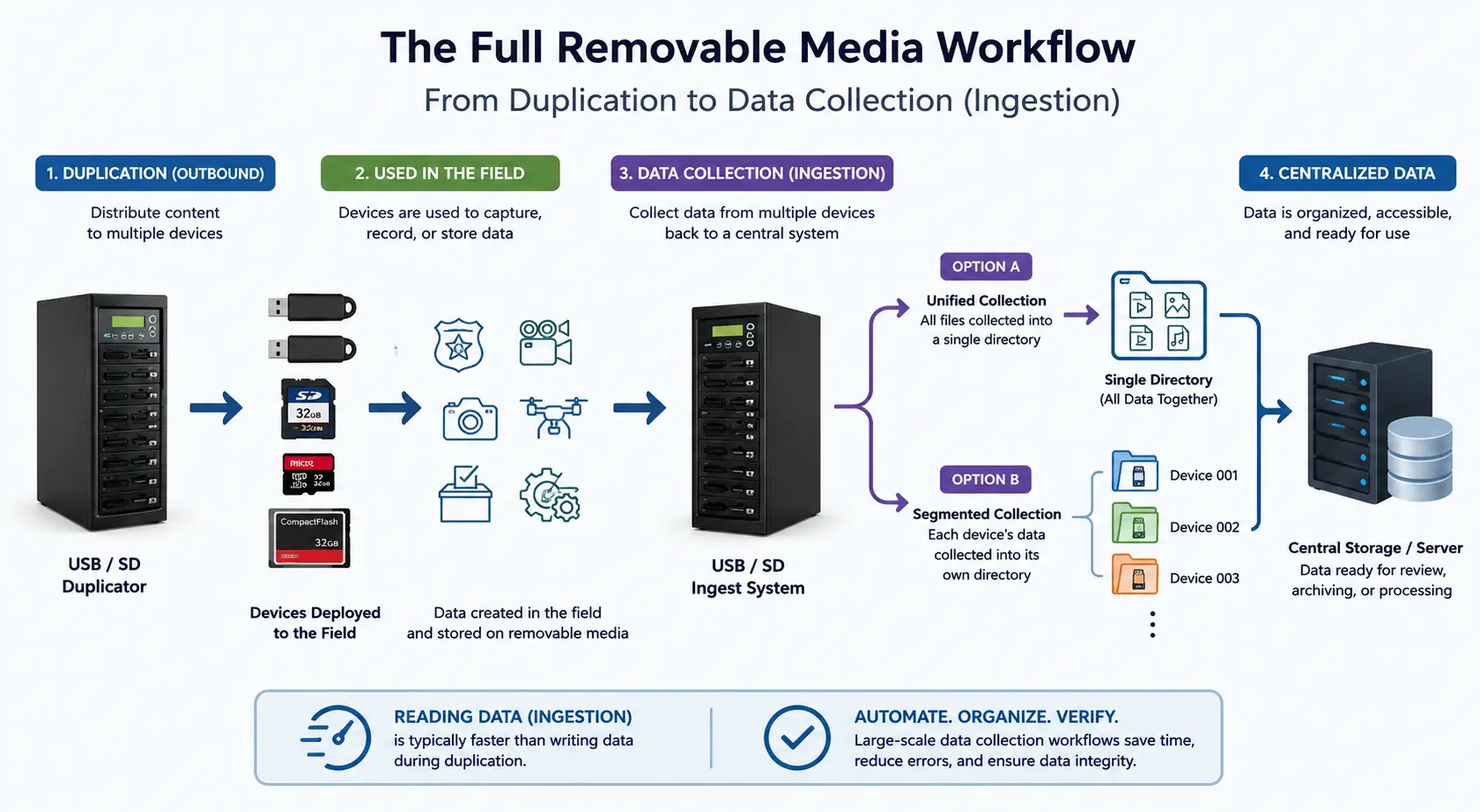

Sistem Duplikasi

Penyalinan produksi massal, metode verifikasi, dan desain alur kerja.

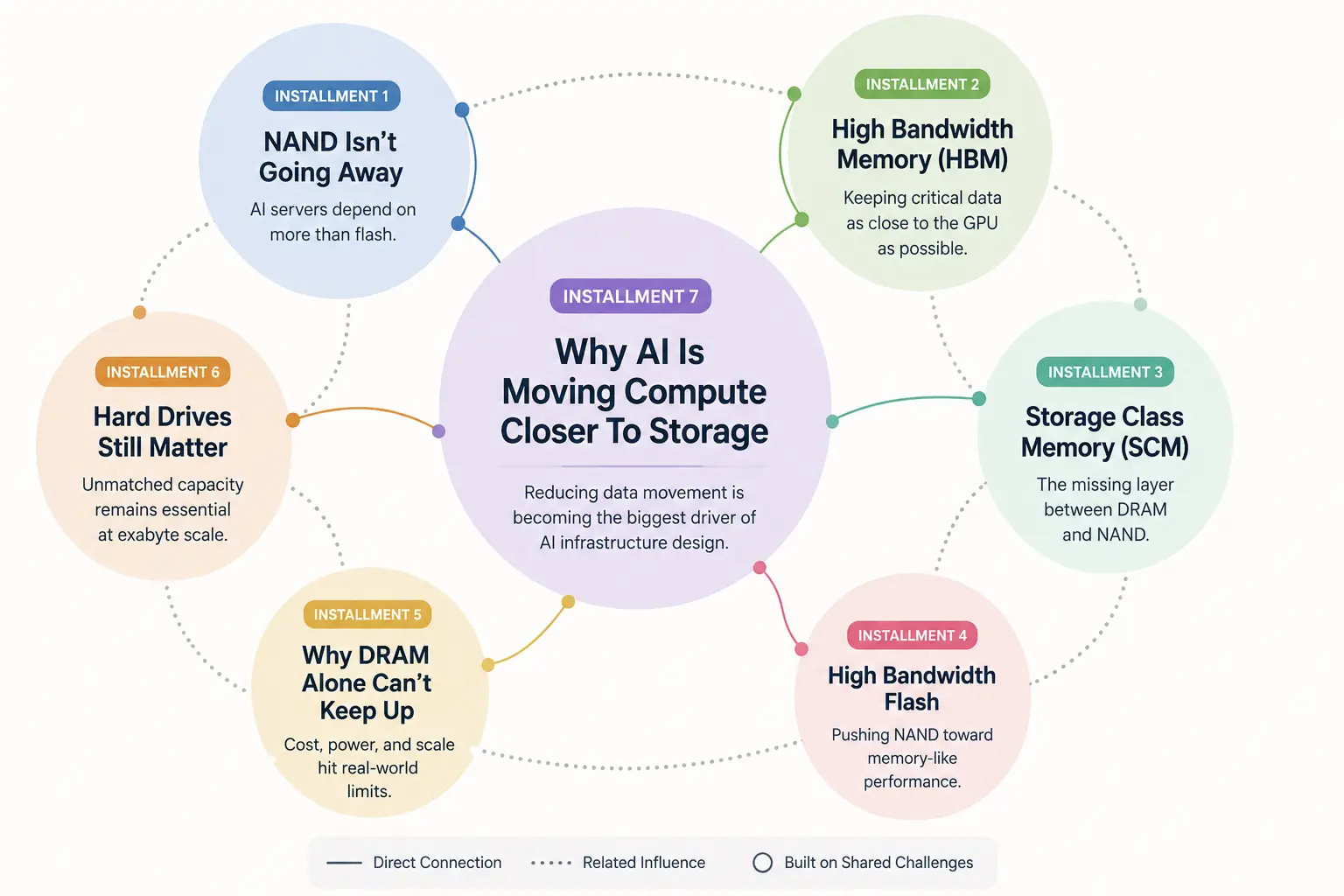

Analisis Industri

Pergeseran pasar, kendala pasokan, permintaan AI, dan dinamika harga flash storage.

Analisis Unggulan

Pembahasan mendalam tentang perilaku USB di dunia nyata, ekonomi memori kilas, keputusan kontroler, dan kompromi keamanan.

Artikel Terbaru

Jika Kita Tidak Bisa Memindahkan Air Melintasi California, Bagaimana Kita Akan Membangun Kota di Mars?

Sisi yang Sering Terlewat dari Media Lepas-Pasang: Workflow Pengumpulan Data Skala Besar

KV Cache: Reservoir Memori AI yang Menjaga GPU Tidak Kehabisan Aliran Data

Mara Vale: Gema Air-Gapped | Cyberpunk Noir tentang Sinyal Tak Terlihat dan Kebocoran Data

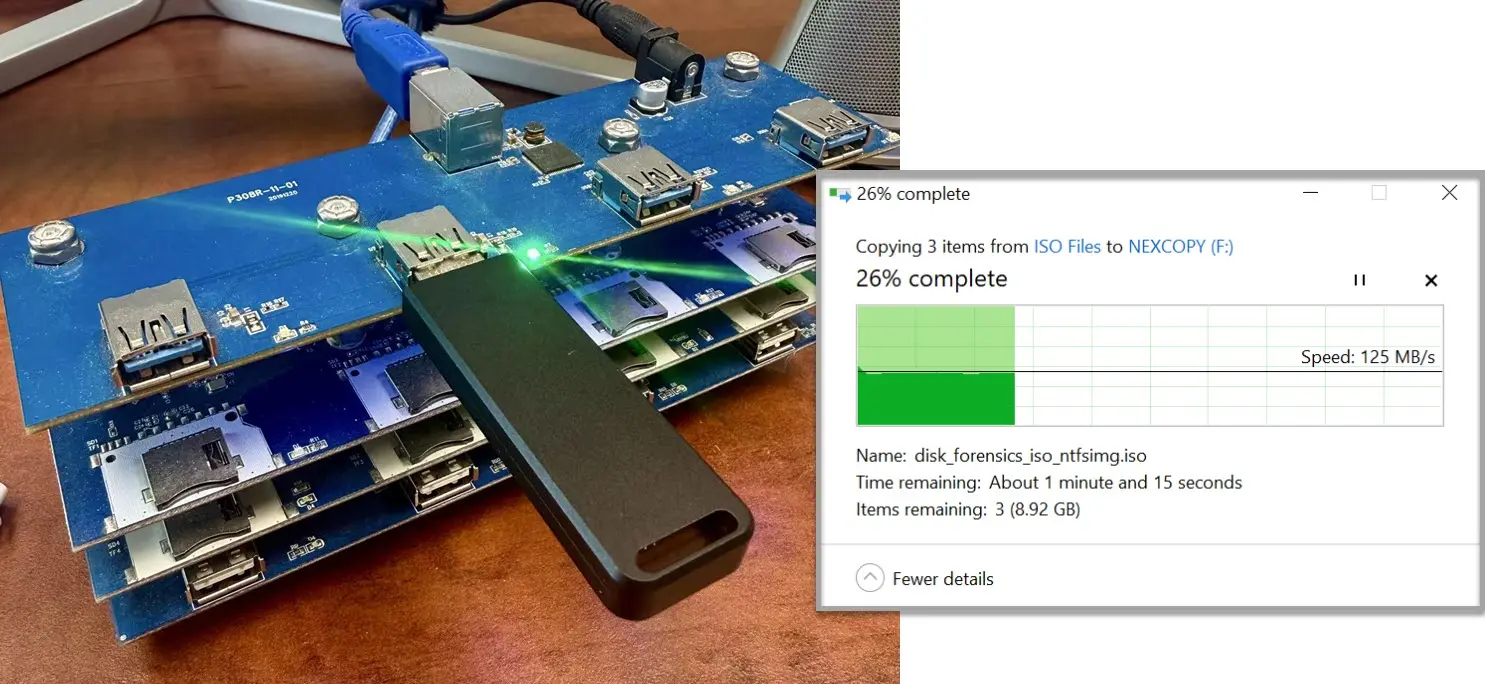

Mengapa Flash Drive USB 300MB/s Melambat Setelah 20 Detik