Apa itu High Bandwidth Memory (HBM) dan mengapa AI bergantung padanya

Sistem AI biasanya tidak melambat karena keterbatasan komputasi, melainkan karena sistem tidak mampu memindahkan data cukup cepat untuk terus “memberi makan” prosesor dengan informasi secara konsisten.

Dengan kata lain, bottleneck-nya bukan pada kemampuan memproses data, tetapi pada kemampuan mengirimkan data tersebut dengan kecepatan yang dibutuhkan oleh workload AI modern.

Di sinilah High Bandwidth Memory (HBM) menjadi bagian penting dari arsitektur.

Untuk melihat gambaran yang lebih luas tentang bagaimana memori berkembang melampaui flash dan mengapa sistem AI sekarang bergantung pada beberapa lapisan, lihat analisis utama kami: NAND tidak akan hilang, tapi server AI sekarang bergantung pada lebih dari sekadar flash.

Apa itu High Bandwidth Memory (HBM)?

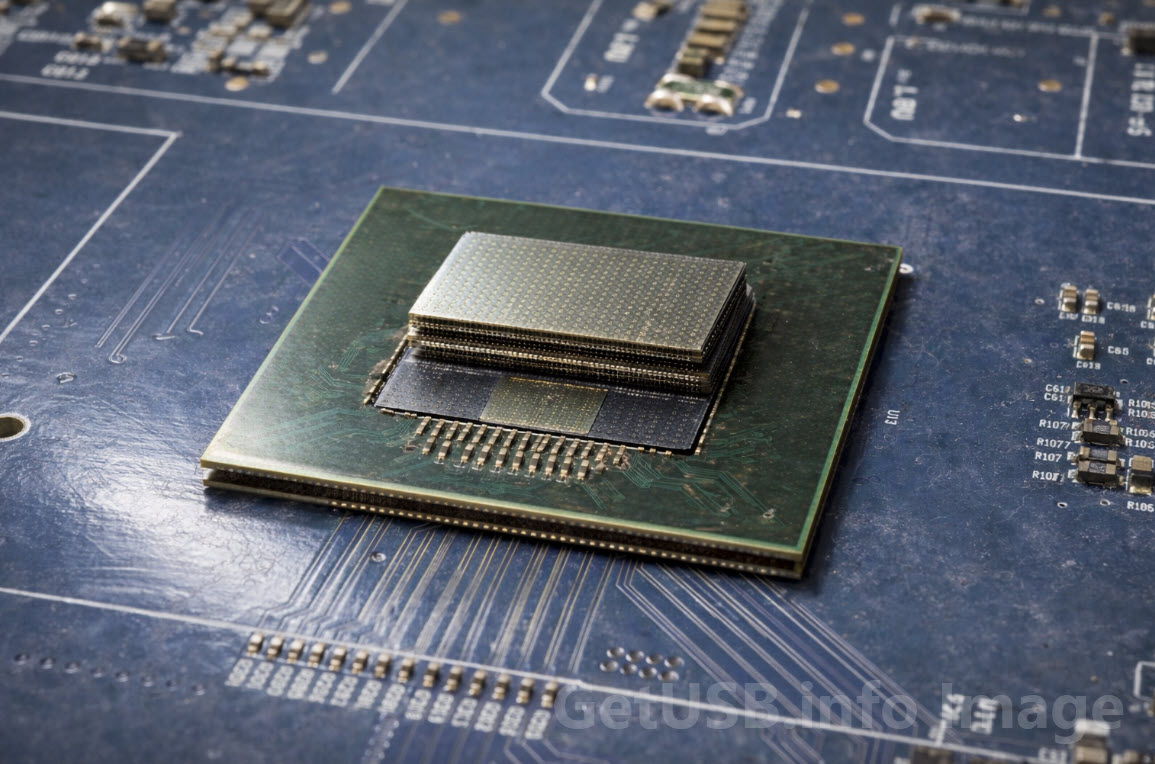

High Bandwidth Memory adalah jenis DRAM bertumpuk yang ditempatkan sangat dekat dengan prosesor, sering kali hanya berjarak beberapa milimeter dari die GPU, untuk meminimalkan jarak fisik yang harus ditempuh oleh data.

Berbeda dengan memori sistem tradisional yang mengandalkan jalur listrik yang lebih panjang dan kanal data yang lebih sempit, HBM dirancang berdasarkan kedekatan dan paralelisme, sehingga memungkinkan lebih banyak data dipindahkan sekaligus dengan latensi yang jauh lebih rendah.

- Bus memori yang sangat lebar, sering kali ribuan bit

- Jarak jalur yang sangat pendek antara memori dan prosesor

- Akses data secara paralel dalam jumlah besar

Tujuannya sederhana: mengurangi jarak antara tempat data disimpan dan tempat data diproses, karena dalam sistem berkinerja tinggi, bahkan penundaan kecil pun akan cepat terakumulasi.

Dalam praktiknya, jarak langsung berbanding lurus dengan latensi, dan latensi adalah salah satu faktor utama yang membatasi performa AI.

Cara sederhana untuk memahami HBM

Cara yang mudah untuk membayangkan hal ini adalah dengan melihat sistem tradisional sebagai sebuah pabrik yang terhubung ke gudang melalui jalan raya.

Setiap kali pabrik membutuhkan komponen, komponen tersebut harus dikirim bolak-balik, yang menimbulkan penundaan, meningkatkan penggunaan energi, dan membatasi seberapa cepat sistem dapat beroperasi.

HBM mengubah hubungan tersebut dengan cara “menumpuk” gudang langsung di atas lantai pabrik.

Alih-alih bergantung pada proses transportasi, semuanya langsung tersedia, sehingga menghilangkan penundaan yang biasanya terjadi saat data harus berpindah jarak jauh.

Inilah yang dilakukan HBM untuk GPU, yaitu menempatkan memori begitu dekat dengan mesin komputasi sehingga perpindahan data menjadi hampir seketika dibandingkan dengan desain tradisional.

Bagaimana HBM dibangun secara fisik

Keunggulan HBM tidak hanya terletak pada tata letaknya, tetapi juga pada bagaimana memori tersebut dibangun di tingkat silikon.

HBM dibuat dengan menumpuk beberapa die DRAM secara vertikal dan menghubungkannya menggunakan Through-Silicon Vias (TSV), yaitu jalur vertikal mikroskopis yang dibor melalui silikon untuk memungkinkan koneksi listrik langsung antar lapisan.

Modul memori bertumpuk ini kemudian dipasang pada sebuah interposer bersama GPU, membentuk paket terintegrasi yang sangat rapat di mana memori dan komputasi bekerja sebagai satu sistem terpadu, bukan sebagai komponen terpisah.

Hasilnya adalah kombinasi jalur data yang sangat lebar dan jarak listrik yang sangat pendek, yang bersama-sama memungkinkan bandwidth tinggi yang menjadi ciri khas HBM.

Mengapa AI bergantung pada HBM

Workload AI, terutama dalam pelatihan model, membutuhkan pergerakan data dalam jumlah besar secara terus-menerus, sering kali melibatkan miliaran bahkan triliunan parameter yang harus dibaca, diperbarui, dan ditulis ulang berulang kali.

Hal ini menciptakan kebutuhan akan bandwidth tinggi untuk memindahkan dataset besar dengan cepat, sekaligus latensi rendah agar unit komputasi tidak menganggur saat menunggu data.

- Bandwidth tinggi memastikan volume data besar dapat dipindahkan dengan cepat

- Latensi rendah memastikan unit komputasi tetap digunakan secara maksimal

Arsitektur memori tradisional kesulitan memenuhi kedua kebutuhan ini secara bersamaan, itulah sebabnya HBM menjadi komponen standar dalam akselerator AI kelas atas.

Tanpa HBM, bahkan GPU paling kuat sekalipun akan menghabiskan sebagian besar waktunya hanya untuk menunggu data alih-alih memprosesnya.

Kompromi: kecepatan vs biaya

Meskipun HBM memberikan keuntungan performa yang signifikan, teknologi ini juga membawa kompleksitas dan biaya tambahan karena desain bertumpuk dan kebutuhan packaging yang canggih.

Penggunaan beberapa lapisan DRAM, interkoneksi presisi, dan integrasi berbasis interposer menjadikan HBM sebagai salah satu teknologi memori paling mahal yang tersedia saat ini.

Karena itu, HBM biasanya digunakan pada aplikasi di mana performa sangat penting dan biaya dapat dibenarkan, seperti pelatihan AI dan lingkungan komputasi berkinerja tinggi.

Sistem umum yang lebih sensitif terhadap biaya tetap mengandalkan solusi memori yang lebih konvensional.

Posisi HBM dalam gambaran besar

HBM tidak menggantikan jenis memori lainnya, melainkan berada di lapisan paling atas dalam hierarki memori berlapis, di mana setiap lapisan dioptimalkan untuk keseimbangan yang berbeda antara kecepatan, biaya, dan kapasitas.

| Teknologi | Latensi tipikal | Bandwidth | Biaya per GB | Peran utama |

|---|---|---|---|---|

| HBM (DRAM bertumpuk) | Nanodetik | Terabyte/detik | Sangat tinggi | Memori untuk pelatihan AI |

| DDR DRAM | ~100ns | Tinggi | Tinggi | Memori sistem |

| NVMe SSD | Mikrodetik–milidetik | Sedang | Rendah | Penyimpanan massal |

Setiap lapisan ada karena adanya kompromi antara performa, biaya, dan kapasitas, dan tidak ada satu teknologi pun yang dapat mengoptimalkan ketiganya sekaligus.

HBM berada di tingkat performa tertinggi, di mana kecepatan lebih diprioritaskan daripada biaya, sehingga menjadi sangat penting untuk workload yang tidak bisa mentoleransi keterlambatan.

Pergeseran

HBM tidak seharusnya dipandang hanya sebagai memori yang lebih cepat, tetapi sebagai perubahan dalam desain sistem yang mendekatkan memori secara fisik ke komputasi untuk menghilangkan salah satu bottleneck terbesar dalam komputasi modern.

Dalam sistem AI, di mana performa sangat bergantung pada seberapa cepat data dapat diakses dan diproses, perubahan arsitektur ini memainkan peran yang sangat penting.

Pada akhirnya, bahkan prosesor paling canggih pun bergantung pada aliran data yang stabil, dan peningkatan aliran inilah yang membuat teknologi seperti HBM menjadi sangat penting.

Catatan editorial dan gambar: Artikel ini disusun dan ditinjau oleh GetUSB.info berdasarkan riset editorial kami dan pemahaman teknis tentang packaging memori dan perangkat keras penyimpanan.

Penjelasan gambar: Gambar yang digunakan dalam artikel ini didasarkan pada foto chip dunia nyata dan telah disempurnakan untuk membantu menjelaskan konsep HBM kepada pembaca. Penyempurnaan ini dilakukan hanya untuk tujuan visualisasi, sehingga gambar tersebut harus dipahami sebagai ilustrasi interpretatif yang realistis, bukan sebagai foto referensi manufaktur yang sebenarnya.

Bagaimana artikel ini dibuat: GetUSB.info menyediakan arah topik, sudut pandang teknis, dan peninjauan editorial akhir. Alat AI digunakan untuk membantu ritme dan alur, dengan pengawasan manusia diterapkan sepanjang proses.

Tags: HBM, high bandwidth memory, infrastruktur AI, memori AI, memori GPU