Mengapa DRAM Saja Tidak Lagi Mampu Mengimbangi AI

Begitu Anda mulai melihat bagaimana sistem AI sebenarnya dibangun, ada satu kesimpulan yang sangat wajar yang cenderung diambil orang, dan jujur saja, pada awalnya itu memang terdengar sangat masuk akal.

Jika NAND terlalu lambat untuk bagian tertentu dari workload, dan bahkan arsitektur flash yang sudah canggih pun masih menimbulkan cukup banyak jeda hingga terasa dampaknya, maka jawaban yang tampaknya paling jelas adalah menambahkan lebih banyak DRAM. Bagaimanapun juga, DRAM selalu menjadi lapisan yang cepat. Di sanalah data aktif berada, responsnya cepat, dan selama puluhan tahun itu adalah bagian sistem yang Anda andalkan ketika Anda tidak ingin prosesor hanya duduk diam menunggu sesuatu datang.

Jadi asumsi itu mudah dibuat: jika masalahnya adalah kecepatan, maka perluas saja hal tercepat yang sudah Anda miliki.

Logika itu terlihat masuk akal sampai AI masuk ke dalam gambar dan mulai mendorong DRAM ke peran yang sebenarnya tidak pernah dirancang untuk ditanggung sepenuhnya. Masalahnya bukan karena DRAM tiba-tiba menjadi lambat, usang, atau entah bagaimana kurang berguna dibanding sebelumnya. Masalahnya adalah workload AI meminta jauh lebih banyak dari DRAM daripada sekadar menjadi lapisan kerja cepat antara compute dan storage.

Untuk kerangka besar di balik pergeseran ini, artikel ini terhubung langsung ke artikel pilar utama di sini: NAND tidak akan hilang, tapi server AI sekarang bergantung pada lebih dari sekadar flash.

DRAM Dibangun untuk Kecepatan, Bukan untuk Menanggung Seluruh Sistem

Hal pertama yang perlu dipahami adalah bahwa DRAM sejak awal selalu dioptimalkan untuk kecepatan dan responsivitas, bukan untuk menampung data dalam jumlah sangat besar pada skala masif. Dalam komputasi tradisional, perbedaan itu jarang menjadi masalah karena sebagian besar workload memiliki pemisahan yang cukup jelas antara data aktif dan data yang disimpan. Sistem menyimpan apa yang langsung dibutuhkan di memori, mengambil sisanya dari storage saat diperlukan, dan perpindahan itu biasanya cukup baik sehingga hampir tak ada yang benar-benar memikirkannya terlalu jauh.

AI mengubah keseimbangan itu secara cukup drastis. Alih-alih memproses potongan kecil data aktif lalu melanjutkan, model AI cenderung terus kembali ke dataset besar, memindahkan informasi secara paralel, dan menjaga bagian working set yang jauh lebih besar tetap berada dalam jangkauan lapisan compute untuk jangka waktu yang lebih lama. Itu berarti DRAM tidak lagi hanya diminta menahan tugas yang sedang berjalan. DRAM sekarang diminta membantu menampung kumpulan data yang sangat besar dan terus berubah, yang ingin selalu berada dekat dengan sistem setiap saat.

Itu adalah pekerjaan yang sangat berbeda.

Itulah juga sebabnya teknologi di atas dan di sekitar DRAM menjadi semakin penting. Dalam artikel sebelumnya tentang apa itu High Bandwidth Memory dan mengapa AI bergantung padanya, fokusnya adalah memindahkan sejumlah kecil data penting sangat dekat ke prosesor agar GPU tetap terus terisi data. Artikel itu menegaskan bahwa kedekatan memang penting, tetapi secara diam-diam juga mengungkap masalah berikutnya, karena begitu working set tumbuh melampaui lapisan terdekat itu, sistem tetap harus memutuskan di mana semua hal lainnya akan ditempatkan.

Tembok Pertama Adalah Biaya, dan Itu Muncul Sangat Cepat

Salah satu alasan mengapa banyak orang menyukai gagasan “tinggal tambahkan lebih banyak DRAM” adalah karena terdengar bersih dan langsung. Dalam praktiknya, itu menjadi mahal dengan sangat cepat. Harga DRAM jelas tidak seperti NAND, dan ketika Anda mulai menskalakan sistem ke wilayah AI, Anda tidak lagi bicara soal menambahkan sedikit memori ekstra ke sebuah server. Anda sedang membicarakan ratusan gigabyte, kadang jauh lebih besar, tersebar di banyak node, rack, dan cluster.

Pada titik itu, DRAM berhenti terasa seperti peningkatan performa dan mulai terlihat seperti beban infrastruktur. Kurva biayanya tidak naik pelan-pelan. Kurva itu menanjak cukup cepat sampai gagasan menggunakan DRAM untuk menyelesaikan setiap masalah lokalitas data mulai runtuh di bawah beban ekonominya sendiri.

Itulah salah satu alasan mengapa memory stack kini menjadi lebih dalam, bukan lebih sederhana. Industri tidak menjauh dari DRAM karena nilainya hilang. Industri menjauh dari asumsi bahwa DRAM sendirian bisa menjadi jawaban untuk setiap masalah sensitif latensi pada skala AI.

Tembok Kedua Adalah Daya, dan Masalah Ini Tidak Pernah Tidur

Bahkan jika biaya lebih mudah dibenarkan, DRAM tetap menghadapi masalah lain yang mustahil diabaikan begitu sistem menjadi cukup besar, yaitu daya. DRAM harus terus-menerus diberi daya untuk mempertahankan statusnya. Itu memang bagian dari teknologinya. Jadi semakin banyak Anda menambahkannya, semakin banyak pula energi yang dikonsumsi sistem hanya untuk menjaga data tetap berada di sana dan siap digunakan.

Di lingkungan yang lebih kecil, overhead itu mungkin terasa bisa diterima. Dalam sistem AI padat yang berjalan terus-menerus, itu mulai menjadi masalah operasional yang serius. Lebih banyak DRAM berarti lebih banyak konsumsi daya, lebih banyak panas, lebih banyak pendinginan, dan lebih banyak tekanan desain pada seluruh platform. Tiba-tiba keputusan ini bukan lagi hanya soal kapasitas memori. Ini menjadi soal batas termal, efisiensi pusat data, dan apakah infrastruktur pendukung sanggup menyerap biaya untuk menjaga memori aktif sebanyak itu tetap hidup sepanjang waktu.

Di sinilah peran lapisan perantara mulai terasa lebih masuk akal. Dalam artikel sebelumnya tentang Storage Class Memory, lapisan yang hilang antara DRAM dan NAND, idenya bukan untuk menggantikan DRAM, tetapi untuk meringankan sebagian tekanannya dengan menambahkan lapisan yang menjaga lebih banyak data tetap dekat dengan compute tanpa memaksa semuanya masuk ke tier yang paling mahal dan paling boros daya.

Lalu Ada Kenyataan Fisik dari Kedekatan

Ada alasan lain mengapa DRAM tidak bisa diskalakan tanpa batas dengan baik dalam sistem AI, dan itu lebih sedikit berkaitan dengan anggaran serta lebih banyak berkaitan dengan fisika. DRAM bernilai sebagian karena letaknya relatif dekat dengan prosesor. Semakin dekat memori ke compute, biasanya semakin rendah latensinya dan semakin responsif keseluruhan sistem terasa. Namun kedekatan bukanlah sesuatu yang bisa terus Anda perluas selamanya tanpa konsekuensi.

Ada batas fisik untuk seberapa banyak memori yang bisa ditempatkan dekat CPU atau GPU sebelum kompleksitas tata letak, panjang jalur sinyal, integritas sinyal, dan batasan packaging mulai berbalik melawan Anda. Inilah tepatnya alasan mengapa advanced memory packaging muncul sejak awal. HBM ada karena penempatan DRAM tradisional hanya bisa melangkah sampai batas tertentu, dan begitu sisi compute menjadi cukup cepat, jarak dan jalur itu mulai menjadi jauh lebih penting daripada sebelumnya.

Tetapi HBM juga bukan jawaban penuh untuk masalah kapasitas. HBM menawarkan bandwidth yang luar biasa, tetapi bukan volume tanpa batas. Akibatnya, sistem hidup dalam tindakan menyeimbangkan yang terus-menerus antara apa yang bisa ditempatkan sangat dekat dan apa yang harus diletakkan lebih jauh. Workload AI menekan keseimbangan itu jauh lebih keras daripada yang pernah terjadi pada sistem konvensional.

AI Membuat Keterlambatan Kecil Menjadi Mahal

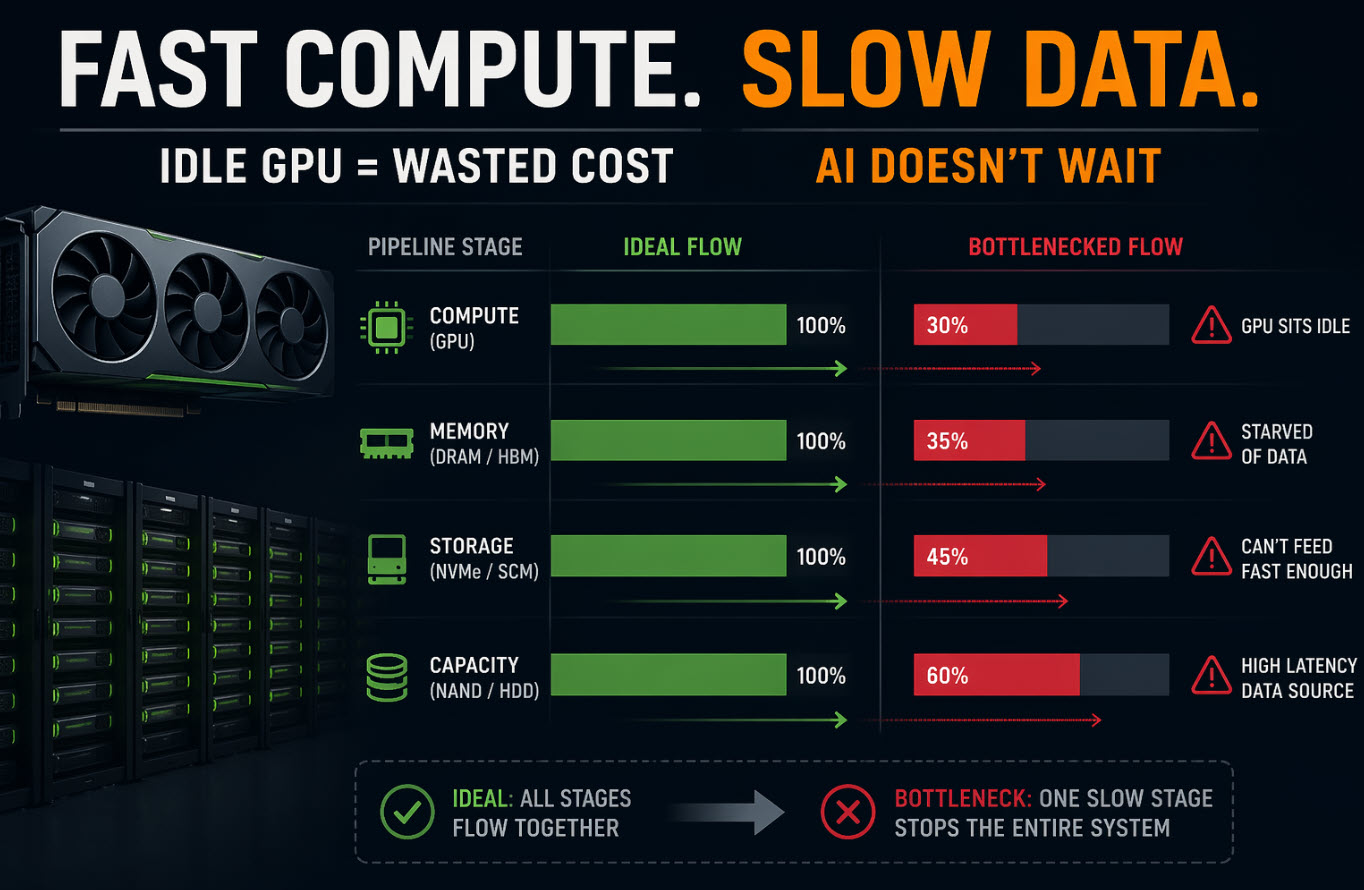

Salah satu hal yang lebih menarik dari infrastruktur AI adalah bahwa ia menyingkap inefisiensi yang dulu bisa disembunyikan oleh workload yang lebih lama. Dalam sistem yang lebih tradisional, sedikit keterlambatan dalam akses data mungkin tidak berarti banyak. Prosesor menunggu sebentar, tugas selesai sedikit lebih lambat, dan pengguna tidak pernah menyadarinya. Sistem AI jauh lebih tidak toleran karena beroperasi dengan paralelisme yang sangat besar dan karena begitu banyak uang terikat pada lapisan compute.

Jika GPU tidak mendapatkan data saat dibutuhkan, itu bukan sekadar gangguan teknis. Itu adalah waktu menganggur yang mahal. Kalikan hal itu di banyak accelerator yang berjalan paralel, dan bahkan keterlambatan yang sangat kecil pun mulai tampak sebagai kerugian nyata dalam utilisasi.

Itu mengubah tujuannya. Tujuannya bukan sekadar memiliki memori yang cepat. Tujuannya adalah mempertahankan pengiriman data yang konsisten pada skala yang cukup besar untuk membuat bagian paling mahal dari sistem terus sibuk setiap saat. Itu adalah tuntutan yang jauh lebih berat, dan itulah tepatnya alasan mengapa DRAM saja mulai terlihat tidak memadai setelah infrastruktur AI tumbuh melampaui titik tertentu.

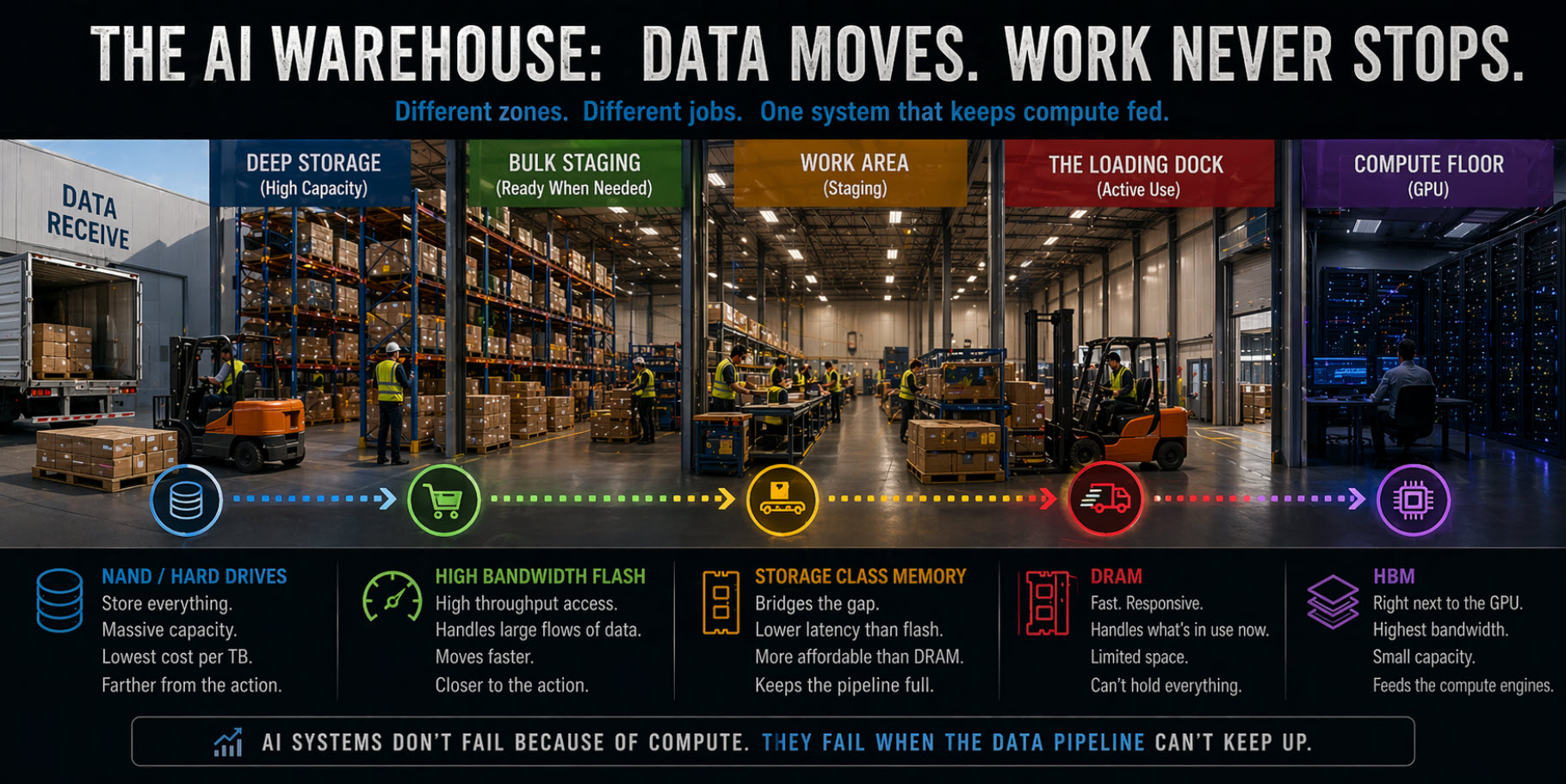

Analogi Gudang Itu Masih Tetap Berlaku – Hanya Saja Ukurannya Menjadi Lebih Besar

Jika kita terus memakai analogi gudang yang sama dari artikel-artikel sebelumnya, DRAM masih merupakan loading dock. Di situlah pekerjaan aktif terjadi, di situlah barang dibuka, disortir, dan dipindahkan ke penggunaan langsung. Selama bertahun-tahun, model itu bekerja dengan baik karena jumlah aktivitas di loading dock masih bisa dikelola dan sistem tidak menuntut agar semuanya dipersiapkan di sana pada saat yang sama.

AI mengubah skala operasinya. Sekarang loading dock diharapkan menopang arus material yang hampir terus-menerus, dengan jauh lebih banyak aktivitas yang berlangsung secara paralel dan jauh lebih sedikit toleransi terhadap keterlambatan. Pada titik tertentu, bahkan loading dock terbaik pun tidak bisa terus berkembang begitu saja. Hanya ada sejumlah ruang tertentu, hanya ada sejumlah gerakan paralel tertentu yang bisa berlangsung dengan efisien, dan hanya ada sejumlah persediaan tertentu yang bisa Anda simpan langsung di titik penggunaan sebelum tata letaknya sendiri menjadi bagian dari masalah.

Jadi jawabannya bukan membuat loading dock itu menjadi tak terbatas besarnya. Jawabannya adalah merancang ulang workflow di sekelilingnya.

Di sinilah sisa hierarki memori mulai layak mendapatkan tempatnya. HBM menjaga data yang paling sensitif terhadap waktu tetap tepat di samping prosesor. Storage Class Memory membantu menghaluskan transisi antara memori aktif dan storage yang lebih lambat. Dan dalam artikel yang lebih baru tentang mengapa sistem AI modern mengonsumsi begitu banyak memori, fokusnya bergeser ke bagaimana sisi storage juga sedang didesain ulang agar bisa ikut berperan lebih cerdas dalam memberi makan sistem.

Tidak satu pun dari lapisan-lapisan itu ada karena DRAM gagal. Lapisan-lapisan itu ada karena AI telah melampaui gagasan bahwa satu lapisan cepat saja dapat menanggung seluruh workload sendirian.

Apa Arti Sebenarnya Semua Ini bagi Memory Stack AI

Inti sebenarnya di sini bukanlah bahwa DRAM akan hilang, karena jelas itu tidak terjadi. DRAM tetap menjadi salah satu bagian paling penting dari seluruh stack. Yang berubah adalah perannya. Alih-alih menjadi tempat di mana semua data aktif seharusnya tinggal, DRAM kini menjadi tempat bagi data yang paling mendesak dan paling sensitif terhadap waktu, sementara lapisan lain menangani beban yang terus tumbuh dari skala, biaya, dan kapasitas.

Itu adalah pergeseran yang halus, tetapi penting. Itu berarti infrastruktur AI sedang menjauh dari gagasan lama tentang model dua lapis yang sederhana – memori di sini, storage di sana – dan bergerak menuju sesuatu yang jauh lebih bernuansa, di mana teknologi yang berbeda masing-masing diminta menangani bagian workload yang paling cocok untuk mereka.

Sederhananya, DRAM masih sangat penting, tetapi tidak lagi cukup jika berdiri sendiri. AI telah mengubah ukuran working set, kecepatan compute, biaya keterlambatan, dan ekonomi dari menjaga semuanya tetap dekat. Begitu semua hal itu berubah pada saat yang sama, hierarki memori juga harus berubah bersamanya.

Ke Mana Ini Akan Mengarah Selanjutnya

Begitu Anda menerima bahwa DRAM tidak bisa cukup jauh “meregang” untuk menampung semua yang ingin dijaga AI tetap dekat ke compute, pertanyaan berikutnya menjadi cukup jelas. Di mana sebenarnya sisa data itu tinggal, terutama ketika jumlah informasinya terlalu besar untuk dibenarkan jika semuanya harus dipertahankan di memori?

Di sinilah percakapan kembali berbelok, dan sebuah teknologi yang oleh banyak orang dianggap sudah tersisih justru mulai menjadi penting dengan cara yang cukup mengejutkan. Karena sementara DRAM bergumul dengan skala dan flash masih membawa kompromi biaya serta latensinya sendiri, hard drive tetap menawarkan sesuatu yang sulit digantikan oleh bagian stack lainnya: kapasitas yang praktis dalam volume sangat besar.

Dan itulah tepatnya alasan mengapa bagian berikutnya dari seri ini harus melihat mengapa hard drive masih sangat penting bagi infrastruktur AI.

Tentang Penulis

Artikel ini dikembangkan di bawah arahan Mike McCrosky, kontributor lama GetUSB.info yang memiliki lebih dari dua dekade pengalaman dalam teknologi USB, perilaku memori flash, dan sistem penyimpanan data. Perspektif yang disajikan di sini mencerminkan pengetahuan industri yang lahir dari pengalaman langsung serta analisis berkelanjutan tentang bagaimana sistem nyata bekerja di bawah workload yang terus berkembang, termasuk infrastruktur AI.

Bagaimana Artikel Ini Dibuat

Konsep, struktur, dan arah teknis artikel ini ditulis dan ditinjau oleh seorang ahli manusia di bidangnya. Alat AI digunakan untuk membantu ritme, alur, dan keterbacaan, sehingga ide-ide yang kompleks bisa disusun menjadi narasi yang lebih alami tanpa mengubah akurasi teknis dasar maupun maksud aslinya.

Tentang Visual

Gambar-gambar yang digunakan dalam artikel ini dibuat secara khusus untuk menggambarkan konsep yang sulit ditangkap dengan fotografi stok tradisional, seperti kemacetan aliran data, perilaku hierarki memori, dan inefisiensi pada level sistem. Visual ini dirancang untuk memperkuat penjelasan teknis dan membantu meningkatkan kejelasan bagi pembaca.

Tags: DRAM, HBM vs DRAM, hierarki memori, infrastruktur AI, memori AI