NAND Tidak Akan Hilang, Tapi Server AI Sekarang Bergantung pada Lebih dari Sekadar Flash

Selama lebih dari dua dekade, GetUSB telah membahas bagaimana data benar-benar bergerak, bukan hanya bagaimana ia dipasarkan. Dalam kurun waktu tersebut, kita telah melihat evolusi storage melalui beberapa siklus, mulai dari penurunan hard drive mekanis, naiknya penggunaan flash, hingga sekarang ke sistem di mana storage bukan lagi sekadar komponen pasif, melainkan bagian dari infrastruktur itu sendiri.

Apa yang sedang terjadi sekarang di infrastruktur AI terasa seperti salah satu titik transisi tersebut, tetapi dengan jenis tekanan yang berbeda sebagai pendorongnya.

NAND flash tidak akan hilang, dan sebenarnya tidak ada perdebatan soal itu. NAND tetap menjadi fondasi penyimpanan modern, dan menjalankan perannya dengan sangat baik. Di saat yang sama, permintaan terhadap NAND meningkat dengan cepat, sebagian besar didorong oleh workload AI yang membutuhkan dataset sangat besar dan akses konstan ke data tersebut. Permintaan ini mulai menekan pasokan dengan cara yang semakin sulit diabaikan, baik itu dalam bentuk tekanan harga, alokasi yang lebih ketat, atau sekadar lead time yang lebih panjang untuk deployment berskala besar.

Ketika ketidakseimbangan seperti ini mulai muncul, industri tidak tinggal diam menunggu semuanya kembali normal. Industri mulai mencari cara lain untuk menyelesaikan masalah tersebut, dan di situlah pergeseran mulai terjadi.

Asumsi yang Banyak Orang Buat

Kalau dilihat dari luar, logikanya masih terasa masuk akal. Model AI makin besar, dataset terus berkembang, dan infrastruktur terus dibangun untuk mendukungnya, jadi respons yang paling natural adalah menambahkan lebih banyak storage. Lebih banyak SSD, lebih banyak kapasitas, lebih banyak flash di rack, dan sistem seharusnya bisa mengikuti.

Pendekatan ini sudah lama bekerja, dan di banyak lingkungan masih bekerja sampai sekarang. Namun, asumsi di baliknya adalah bahwa storage berperilaku sama di workload AI seperti pada workload tradisional, dan di sinilah mulai terjadi pergeseran.

Pendekatan ini juga mengasumsikan bahwa NAND akan terus tersedia dalam jumlah yang dibutuhkan dengan harga yang bisa diprediksi, sesuatu yang kini mulai diragukan seiring meningkatnya permintaan.

Di Mana NAND Mulai Menunjukkan Batasnya

NAND flash sangat baik dalam hal yang memang dirancang untuk dilakukannya. Ia menyediakan storage yang padat, andal, dan relatif cepat, dan untuk komputasi umum, ia telah menyelesaikan banyak masalah yang ada pada teknologi sebelumnya. Bahkan saat ini, untuk sebagian besar workload, performanya tetap sesuai ekspektasi.

Namun workload AI meminta sesuatu yang sedikit berbeda, dan perbedaan ini lebih penting daripada yang terlihat sekilas.

Alih-alih sekadar menyimpan data dan mengambilnya kembali saat dibutuhkan, sistem ini membutuhkan aliran data yang stabil dan terus-menerus ke sumber komputasi yang sangat paralel, sering kali dengan kecepatan yang sulit dipertahankan secara konsisten dengan arsitektur storage tradisional. SSD berperforma tinggi memang mampu menangani burst aktivitas dan antrean transaksi besar, tetapi memberi makan ribuan core GPU secara real-time adalah tantangan yang sangat berbeda.

Pada saat yang sama, media dasarnya – NAND itu sendiri – menjadi lebih mahal dan dalam beberapa kasus lebih sulit didapatkan dalam jumlah besar. Jadi sekarang industri menghadapi dua tekanan sekaligus: kebutuhan akan throughput data yang lebih tinggi dan konsisten, serta kenyataan bahwa media utama yang digunakan untuk menyuplai data tersebut sedang berada di bawah tekanan pasokan dan biaya.

Kombinasi inilah yang mendorong pergeseran saat ini. Bukan karena NAND berhenti bekerja, tetapi karena mengandalkannya saja sudah tidak cukup untuk mengikuti kebutuhan sistem AI modern.

Industri Tidak Mengganti NAND – Tapi Membangun di Sekitarnya

Apa yang mulai terjadi di infrastruktur AI bukanlah penggantian NAND secara langsung, dan juga bukan perubahan drastis di mana flash tiba-tiba hilang dari sistem. Justru sebaliknya, NAND masih berada di pusat sistem ini. Perbedaannya adalah sekarang NAND tidak lagi diharapkan untuk menanggung seluruh beban sendirian.

Sebaliknya, industri membangun lapisan tambahan di sekitarnya, di mana setiap lapisan dirancang untuk menangani bagian tertentu dari workload yang memang tidak pernah dimaksudkan untuk ditangani oleh NAND sendirian. Dalam praktiknya, ini berarti memikirkan ulang bagaimana data bergerak dalam sistem, di mana data berada pada setiap tahap, dan seberapa cepat data harus diakses tergantung pada apa yang dilakukan sisi komputasi.

Di sinilah konsep memory stack mulai lebih sering muncul. Bukan sebagai istilah marketing, tetapi sebagai cara praktis untuk menjelaskan apa yang benar-benar diterapkan. Alih-alih memisahkan storage dan memory sebagai dua kategori berbeda, sistem AI mulai mengaburkan batas tersebut dengan menciptakan beberapa tier yang memiliki karakteristik berbeda berdasarkan kecepatan, biaya, dan kedekatan dengan prosesor.

NAND tetap memainkan peran penting dalam stack ini, terutama untuk kapasitas, tetapi sekarang ia berdampingan dengan teknologi lain yang dirancang untuk menangani bagian workload di mana latensi dan bandwidth lebih penting daripada sekadar volume penyimpanan.

Apa yang Dibangun di Sekitar NAND

Ketika melihat sistem dari sudut pandang ini, perubahan yang terjadi menjadi lebih masuk akal. Alih-alih memaksa NAND melakukan semuanya, industri memperkenalkan lapisan lain yang masing-masing menyelesaikan masalah tertentu. Beberapa sudah digunakan di produksi, yang lain masih berkembang, tetapi bersama-sama mereka membentuk struktur yang mulai menjadi andalan server AI modern.

Dalam rangkaian artikel berikutnya, kita akan membahas setiap lapisan ini secara lebih mendalam, karena masing-masing memang layak dibahas lebih detail daripada yang bisa ditampung dalam satu artikel utama. Untuk sekarang, tujuannya adalah menunjukkan bagaimana semua bagian ini saling terhubung.

High Bandwidth Memory (HBM)

Di bagian paling atas stack, paling dekat dengan GPU, terdapat High Bandwidth Memory atau HBM. Ini adalah jenis DRAM bertumpuk yang secara fisik berada dekat dengan prosesor dan dirancang untuk memberikan throughput data yang sangat tinggi dengan latensi yang sangat rendah. Ini bukan storage dalam arti tradisional, melainkan bentuk memory khusus yang dibuat untuk memastikan GPU modern terus mendapatkan data dengan kecepatan yang dibutuhkan.

HBM bukan soal kapasitas. Ini soal menjaga GPU tetap sibuk, yang dalam sistem AI sering kali merupakan komponen paling mahal di rack. Jika prosesor menunggu data, seluruh sistem menjadi tidak efisien. HBM mengatasi hal ini dengan memprioritaskan bandwidth dan kedekatan dibanding ukuran.

Jika dianalogikan seperti gudang, HBM itu seperti palet barang berikutnya yang sudah tersedia tepat di area loading dock, sudah dibuka dan siap dipindahkan. Anda tidak menambah jumlah inventaris total, tetapi memastikan forklift tidak pernah harus berhenti menunggu.

Untuk melihat lebih dalam bagaimana HBM dibandingkan dengan alternatif baru, kami membahasnya di sini: HBM vs HBF: Why the Memory Hierarchy is Being Stretched

Storage Class Memory (SCM)

Tepat di bawahnya ada kategori yang beberapa tahun lalu hampir tidak benar-benar ada dalam praktik: storage yang berperilaku seperti memory.

Storage Class Memory, atau SCM, mengisi celah antara DRAM dan NAND. Ia tidak secepat memory murni dan tidak sepadat flash, tetapi menawarkan keseimbangan yang membuatnya berguna untuk workload yang membutuhkan akses lebih cepat daripada yang bisa diberikan NAND tanpa harus membayar biaya DRAM dalam skala besar.

Dalam lingkungan AI, lapisan tengah ini membantu menyerap sebagian tekanan yang jika tidak akan langsung jatuh ke NAND, terutama saat menangani dataset kerja besar yang tidak muat sepenuhnya di memory tradisional.

Analogi gudang paling mudah adalah melihat SCM sebagai area staging antara rak utama dan loading dock. Gudang menyimpan semua barang, tetapi terlalu lambat jika harus bolak-balik setiap saat. Dock cepat, tetapi ruangnya terbatas. SCM adalah area di tengah, tempat barang yang kemungkinan besar akan segera dibutuhkan disiapkan agar operasional tetap lancar.

High Bandwidth Flash

Di sinilah mulai menjadi sangat menarik, karena alih-alih memperkenalkan jenis memory yang benar-benar baru, industri juga mencoba mendorong NAND ke level baru.

High Bandwidth Flash adalah upaya untuk membuat flash tidak lagi berperilaku seperti storage tradisional, tetapi lebih seperti perpanjangan dari memory. Tujuannya bukan menggantikan NAND, tetapi mengubah cara akses dan integrasinya agar data bisa dikirim lebih efisien ke lapisan di atasnya.

Dalam banyak hal, ini adalah NAND yang beradaptasi dengan lingkungan baru, bukan digantikan. Ini juga sejalan dengan apa yang kita lihat di transisi teknologi sebelumnya. Teknologi jarang hilang begitu saja, biasanya berevolusi agar tetap relevan.

DRAM dan Batasannya

DRAM masih memainkan peran utama dalam semua ini dan juga tidak akan hilang. Ia tetap menjadi working memory utama untuk sebagian besar sistem, termasuk server AI, dan menangani sebagian besar data aktif yang perlu diakses dengan cepat.

Namun, DRAM tidak bisa terus diskalakan tanpa batas. Biaya, konsumsi daya, dan keterbatasan fisik mulai menjadi faktor, terutama saat sistem semakin besar. Karena itu, DRAM saja tidak cukup untuk menampung seluruh permintaan tambahan dari workload AI, dan inilah alasan lapisan lain mulai diperkenalkan.

Dalam analogi gudang, DRAM adalah lantai loading dock itu sendiri. Di sinilah pekerjaan aktif terjadi. Namun ruangnya terbatas. Pada titik tertentu, Anda tetap membutuhkan area staging di dekatnya dan storage yang lebih dalam di belakang, karena mencoba melakukan semuanya hanya di dock akan menjadi mahal dan tidak efisien.

Kembalinya Hard Drive Secara Diam-diam

Meskipun fokus utama ada pada memory berkecepatan tinggi dan flash, hard drive tradisional masih tetap menjadi bagian dari sistem, terutama di bagian bawah stack di mana biaya per terabyte lebih penting daripada kecepatan.

Sistem AI menghasilkan dan mengonsumsi data dalam jumlah sangat besar, dan tidak semuanya perlu berada di storage berperforma tinggi. Dataset training, arsip, dan data yang jarang diakses tetap membutuhkan tempat, dan untuk itu, hard drive masih menjadi salah satu opsi paling ekonomis.

Mereka tidak bersaing dengan NAND atau memory dalam hal performa, tetapi membantu mengurangi tekanan pada lapisan tersebut dengan menangani kebutuhan storage skala besar.

Mendekatkan Compute ke Storage

Perubahan lain yang mulai mendapat perhatian adalah ide untuk mengurangi jarak perjalanan data sejak awal. Alih-alih terus memindahkan data dalam jumlah besar antara storage dan compute, beberapa arsitektur mulai membawa proses komputasi lebih dekat ke lokasi data berada.

Pendekatan ini tidak menghilangkan kebutuhan akan memory atau storage cepat, tetapi mengubah keseimbangan sistem. Dengan memproses sebagian data lebih dekat ke sumbernya, bottleneck dapat dikurangi dan efisiensi keseluruhan meningkat tanpa harus hanya mengandalkan media yang lebih cepat.

Peran AI Context (KV Cache)

Salah satu faktor yang kurang terlihat namun sangat berpengaruh adalah jumlah data sementara yang dihasilkan oleh model AI saat berjalan. Ini sering disebut sebagai context atau KV cache, dan merepresentasikan kondisi kerja model saat memproses input dan menghasilkan output.

Data ini tidak selalu cocok ditempatkan dalam memory tradisional, terutama dalam skala besar, sehingga sistem mulai memperlakukan storage sebagai perpanjangan dari memory. Ini adalah contoh lain bagaimana batas antara keduanya semakin kabur.

Dalam analogi gudang, KV cache adalah seperti clipboard operasional atau daftar kerja aktif untuk semua yang sedang diproses. Ini bukan inventaris penuh dan bukan penyimpanan jangka panjang, tetapi jika catatan kerja ini menjadi terlalu besar atau sulit diakses, seluruh operasi akan melambat.

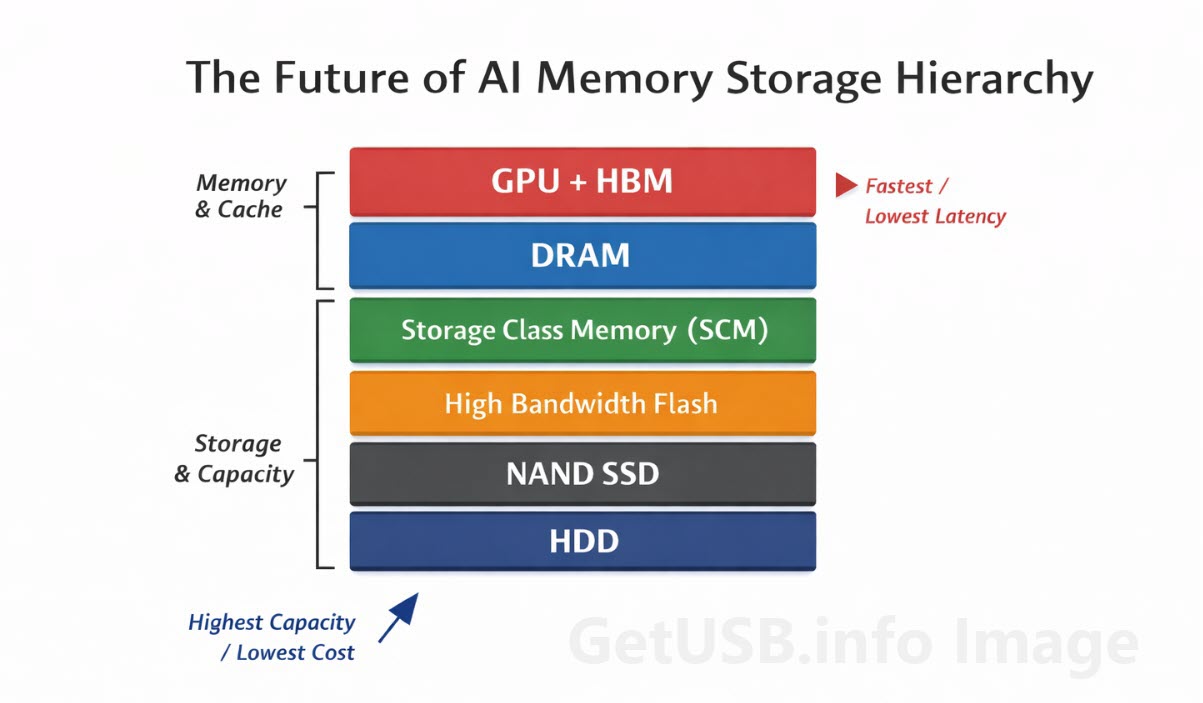

AI Memory Stack yang Baru

Jika melihat sistem secara keseluruhan, struktur ini lebih menyerupai lapisan bertingkat daripada hierarki sederhana.

Di bagian atas, ada GPU dengan HBM untuk operasi berkecepatan tinggi. Di belakangnya ada DRAM untuk workload aktif. Di bawahnya, lapisan seperti SCM dan high-bandwidth flash menjembatani memory dan storage dengan menambahkan kapasitas tanpa terlalu mengorbankan performa.

Lebih ke bawah lagi, NAND menangani penyimpanan skala besar, sementara hard drive berfungsi sebagai penyimpanan jangka panjang yang lebih hemat biaya.

Jika dibayangkan sebagai gudang, strukturnya menjadi jelas. HBM adalah palet di dock, DRAM adalah lantai kerja, SCM adalah area staging, NAND adalah rak utama, dan hard drive adalah penyimpanan bulk di belakang. Sistem ini bekerja karena setiap lapisan punya peran masing-masing.

Setiap lapisan memiliki fungsi, dan bersama-sama mereka membentuk sistem yang lebih cocok untuk kebutuhan AI dibandingkan satu teknologi tunggal saja.

Apa Artinya ke Depan

Intinya bukan bahwa NAND sedang digantikan, atau ada satu teknologi baru yang mengambil alih sepenuhnya. Yang terjadi lebih bertahap, dan dalam banyak hal justru lebih menarik.

Industri mulai menyadari bahwa tidak ada satu lapisan pun yang bisa menangani semuanya, terutama di bawah tekanan workload AI. Alih-alih memaksa satu teknologi melampaui batasnya, sistem dibangun dengan beberapa lapisan yang bekerja bersama.

Pergeseran ini mengubah cara kita memandang storage. Ini bukan lagi hanya soal kapasitas atau kecepatan mentah, tetapi tentang bagaimana data bergerak dalam sistem dan seberapa efisien setiap lapisan mendukung lapisan di atasnya.

Dan seiring arsitektur ini terus berkembang, NAND tetap menjadi bagian penting – hanya saja bukan satu-satunya lagi.

Tags: AI memory stack, HBM, infrastruktur AI, NAND flash, storage class memory